系统调用:贯穿Linux系统编程的隐形主角 在操作系统与用户程序之间,存在一道至关重要的

在操作系统与用户程序之间,存在一道至关重要的受控边界。这道边界,就是贯穿整个Linux系统编程领域的隐形主角——系统调用。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

看看你每天写的代码:

int fd = open("config.json", O_RDONLY);

read(fd, buf, size);

write(1, buf, size);短短三行,三个函数调用。但仔细一想,它们和普通的函数调用有个根本区别:每一次调用,都会触发CPU从“用户态”切换到“内核态”,经历一次代价不菲的特权级切换,然后再切换回来。

这个过程,就是系统调用(System Call)。

真正理解它,你才能看透许多高性能设计的底层逻辑:为什么顶尖的程序要千方百计减少系统调用次数?vDSO凭什么能加速?io_uring又为何比epoll更快?答案都藏在这里。

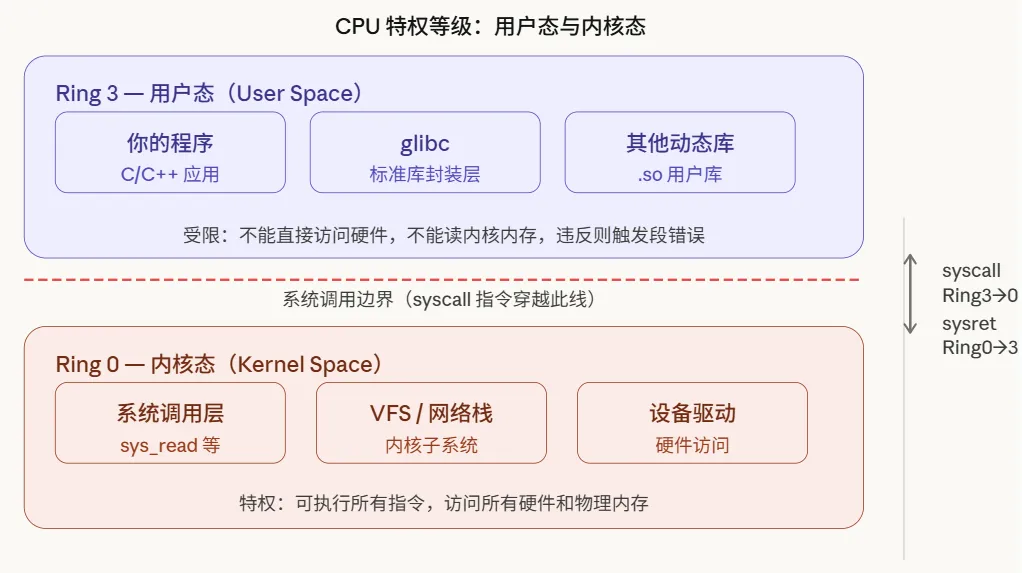

现代CPU(比如x86架构)设计了4个特权等级(Ring 0到Ring 3)。不过,Linux只用了其中两个:

你写的C/C++程序,默认就运行在Ring 3。而操作系统内核,则坐镇Ring 0。这种隔离是系统稳定性的基石——即便用户程序崩溃,也不会把整个内核拖下水。

但问题来了:用户程序总得读文件、发网络包、创建新进程吧?这些操作都需要触及硬件,必须请内核帮忙。怎么安全地“请”呢?答案就是系统调用——一种受控的、从Ring 3进入Ring 0的标准化机制。

图中那道红线,堪称系统中最重要的边界之一。用户态代码无法直接跨越,必须通过syscall指令,以受控的方式向内核发起请求。

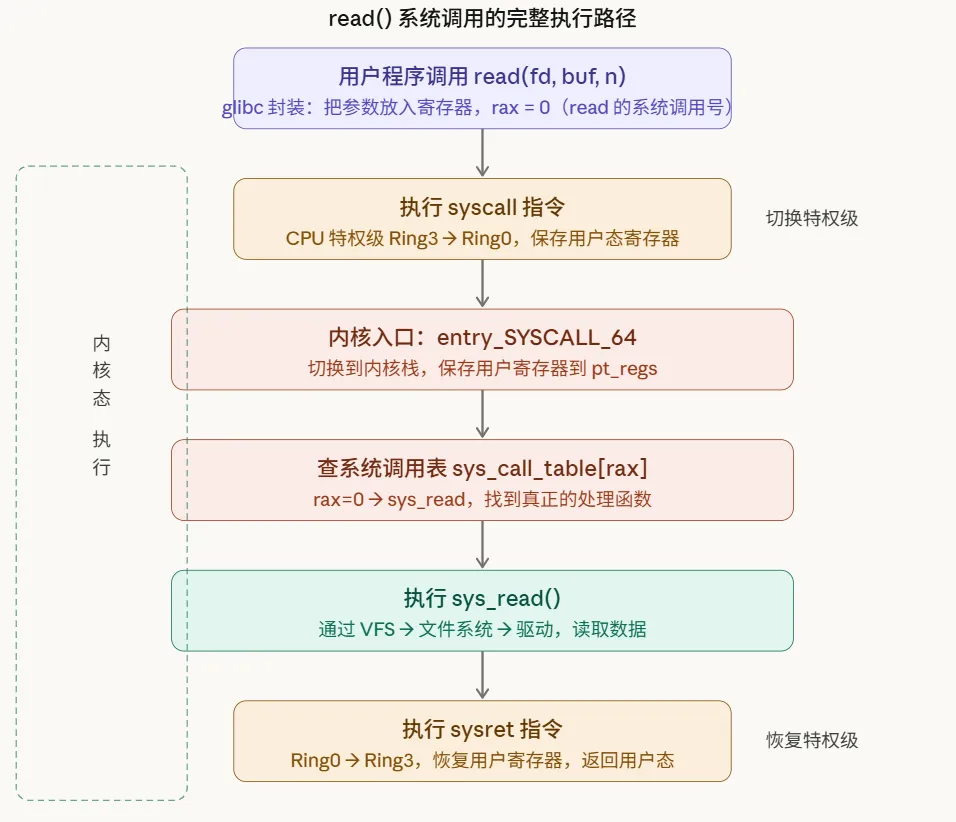

当你调用read(fd, buf, size)时,底层究竟发生了什么?整个过程可以拆解为以下步骤:

整个过程有几个关键细节值得深究:

寄存器约定(x86-64):

syscall指令到底做了什么:

rip(指令指针)和rflags到CPU的特定模型专用寄存器(MSR)。cs(代码段)切换为内核代码段,CPU特权级随之提升至Ring 0。MSR_LSTAR寄存器所存储的地址,即内核的系统调用入口entry_SYSCALL_64。这一切都由CPU硬件直接完成,比古老的软件中断方式(int 0x80)要快得多。

内核里维护着一张核心大表——sys_call_table[],里面按顺序存放着所有系统调用处理函数的地址。rax寄存器里的号码,就是这张表的索引下标。

# 查看 Linux 系统调用表

$ cat /usr/include/x86_64-linux-gnu/asm/unistd_64.h | head -20

#define __NR_read 0 ← read() 对应 0 号

#define __NR_write 1 ← write() 对应 1 号

#define __NR_open 2

#define __NR_close 3

#define __NR_stat 4

...

# x86-64 Linux 共有约 400+ 个系统调用

# 用 strace 实时观察程序发出的系统调用

$ strace ./a.out

execve("./a.out", ...) = 0

openat(AT_FDCWD, "config.json", O_RDONLY) = 3

read(3, "hello", 5) = 5

write(1, "hello", 5) = 5

close(3) = 0strace这个调试利器的本质,就是利用ptrace系统调用拦截目标进程的每一次系统调用,并将其名称、参数和返回值打印出来。

千万别以为系统调用是“免费”的。每一次跨越边界,都会带来一系列开销:

综合下来,一次系统调用的开销大约在100纳秒到1微秒之间。对于追求极致的性能场景,这个数字不容忽视。

这也引出了高性能程序设计的一个核心原则:尽最大可能减少系统调用次数。

// 差:每次写一个字节,触发N次系统调用

for (int i = 0; i < 1000; i++)

write(fd, &buf[i], 1); // 1000 次 write()

// 好:批量写,仅1次系统调用

write(fd, buf, 1000); // 1 次 write()标准I/O库(stdio)的fwrite函数在用户态维护缓冲区,就是为了积累数据,减少底层write()系统调用的实际次数。

有些系统调用极其频繁,但本质上并不需要操作硬件——比如获取时间的gettimeofday(),只是读取一下系统时钟。如果每次都走完整的系统调用路径,未免太浪费了。

于是,Linux引入了vDSO(Virtual Dynamic Shared Object)来解决这个问题。

vDSO是内核映射到每个进程地址空间的一小块特殊内存,里面包含了几个特定“系统调用”的用户态实现:

$ cat /proc/self/maps | grep vdso

7ffd8a7fd000-7ffd8a7ff000 r-xp 00000000 00:00 0 [vdso]

vDSO的工作机制很巧妙:

vvar)里定期更新时钟等值。gettimeofday实现直接从这里读取数据,完全绕过了syscall指令。目前主要受vDSO加速的函数包括:gettimeofday()、clock_gettime()、time()、getcpu()。

我们来直观对比一下不同调用的开销量级:

普通函数调用:~1ns(几个 CPU 周期)

vDSO 函数调用:~10ns(读共享内存)

系统调用:~100~300ns(特权级切换 + 内核处理)

有 Page Table 隔离(PTI,Meltdown 漏洞补丁)的系统调用:~500ns+实际验证一下vDSO的效果:

#include

#include

int main() {

struct timespec t;

// 高频调用 clock_gettime,测量系统调用开销

for (int i = 0; i < 10000000; i++)

clock_gettime(CLOCK_MONOTONIC, &t);

// 因为 vDSO,这里其实没有真正的系统调用

} $ strace -c ./a.out

% time seconds usecs/call calls errors syscall

------ ----------- ----------- --------- --------- --------

0.00 0.000000 0 1 read

...

# clock_gettime 不在这里!因为走了 vDSO,strace 看不到理解了系统调用的开销,很多高性能框架的设计选择就变得一目了然:

fwrite在用户态设置了缓冲区,数据积累到一定量(比如4096字节)才发起一次真正的write()系统调用,将N次调用压缩为1次。epoll模式下,每个就绪的I/O事件通常都需要独立的read()/write()系统调用来处理。而io_uring通过共享内存环形队列,允许批量提交和收割I/O请求,极大减少了系统调用次数,甚至可以实现“零系统调用”的轮询模式。epoll,一次epoll_wait可以处理大量连接事件,将系统调用频率降到极低。根本区别在于CPU特权等级不同。用户态(Ring 3)代码受限,不能直接访问硬件和内核内存;内核态(Ring 0)拥有最高权限,可以执行所有指令、访问所有硬件。两者通过系统调用(syscall指令)进行安全切换,这是操作系统稳定性的基础保障。

普通函数调用只是在同一特权级内跳转到另一个地址,保存恢复少量寄存器,开销在纳秒级。系统调用则必须通过syscall指令触发特权级切换,伴随大量的状态保存、栈切换和内核处理流程,开销在百纳秒级以上。本质区别在于是否发生了特权级切换。

int 0x80是x86 32位时代的旧方式,通过软件中断实现系统调用,需要查询中断描述符表(IDT),开销较大。syscall是x86-64架构专用的快速系统调用指令,CPU直接从MSR寄存器读取内核入口地址,省去了IDT查找步骤,速度大约快50%。现代Linux 64位程序都使用syscall。

因为glibc等C库会自动链接并使用vDSO的实现。它完全不走syscall指令,而是在用户态直接读取内核映射的共享时钟变量,耗时仅10纳秒左右,相比普通系统调用的200纳秒以上,有数量级的优势。

系统调用,是操作系统与用户程序之间那道唯一的、受控的边界。

吃透了它,你就能真正理解:CPU为什么要设计特权等级;为什么“减少系统调用”是性能优化的黄金法则;vDSO如何让时间函数飞起来;以及io_uring为何代表了下一代I/O的方向。

可以说,它是贯穿整个Linux系统编程领域的隐形主角。后续文章中间出现的每一个read()、write()、mmap()或epoll_wait(),其背后都是一次跨越特权边界的精密旅程。

菜鸟下载发布此文仅为传递信息,不代表菜鸟下载认同其观点或证实其描述。