千元机运行本地大模型:性能瓶颈与真实体验 谷歌近期推出的开源模型Gemma 4,其最引人注

谷歌近期推出的开源模型Gemma 4,其最引人注目的特性在于覆盖了从工作站到移动设备的全规格布局。其中专为移动端设计的轻量版本,明确指向一个目标:实现完全离线的本地化AI部署。这并非单纯的技术展示,而是谷歌意图将大模型能力真正植入用户日常设备的战略信号。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

目前网络上的评测,大多基于iPhone或安卓旗舰机型。这些设备凭借顶级的处理器与专用NPU,取得优秀成绩在情理之中。

这引出了一个更具普适性的疑问:对于占据市场主流的中低端安卓机,其搭载的中端芯片与有限算力,能否支撑本地模型的流畅运行?旗舰机与千元机之间的体验差距,究竟有多显著?

(图源:雷科技摄制)

本地AI是否已成为硬件特权?为探究真相,我们选取了一台典型的千元安卓设备,对Gemma 4进行了深度性能压测。

本次测试设备为vivo Y500 Pro,核心搭载联发科天玑7400平台。该芯片采用台积电4nm制程,CPU采用4+4核心架构,GPU为Mali-G615 MC2。其集成的联发科NPU 655,官方宣称AI性能较前代提升15%。这套配置代表了该价位段的普遍水平,日常应用流畅,但AI算力与旗舰芯片存在代际差距。

测试应用为谷歌官方发布的“Google AI Edge Gallery”。部署流程极为简化:从应用商店下载,选择Gemma 4 E4B模型并完成文件下载,即可开始完全离线的交互。这种低门槛部署方式,确实降低了用户尝试本地模型的技术障碍。

(图源:雷科技制图)

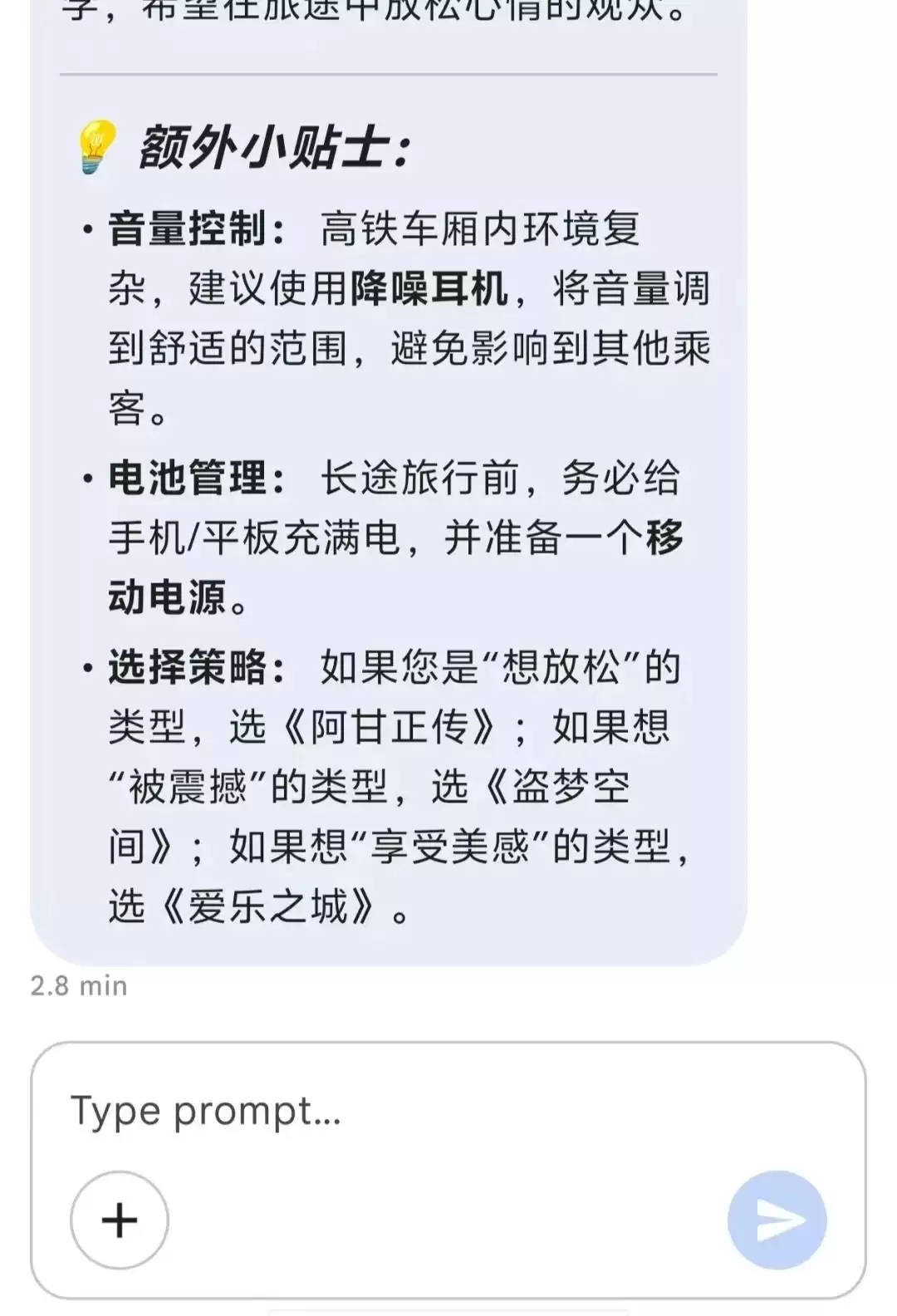

首个测试为生活化提问:“请推荐三部适合长途高铁观看的电影,并简述理由。”模型输出了《阿甘正传》、《盗梦空间》与《爱乐之城》三部影片,理由阐述合理。但问题在于,其生成了一段近500字、包含冗余建议的冗长回复。

(图源:雷科技制图)

在Y500 Pro上,生成这500字耗时长达2.8分钟。回复中充斥大量重复表述与无关补充,这暴露了小参数模型的典型缺陷:缺乏精准的停止生成机制,倾向于通过“车轱辘话”填充内容,核心信息密度低。

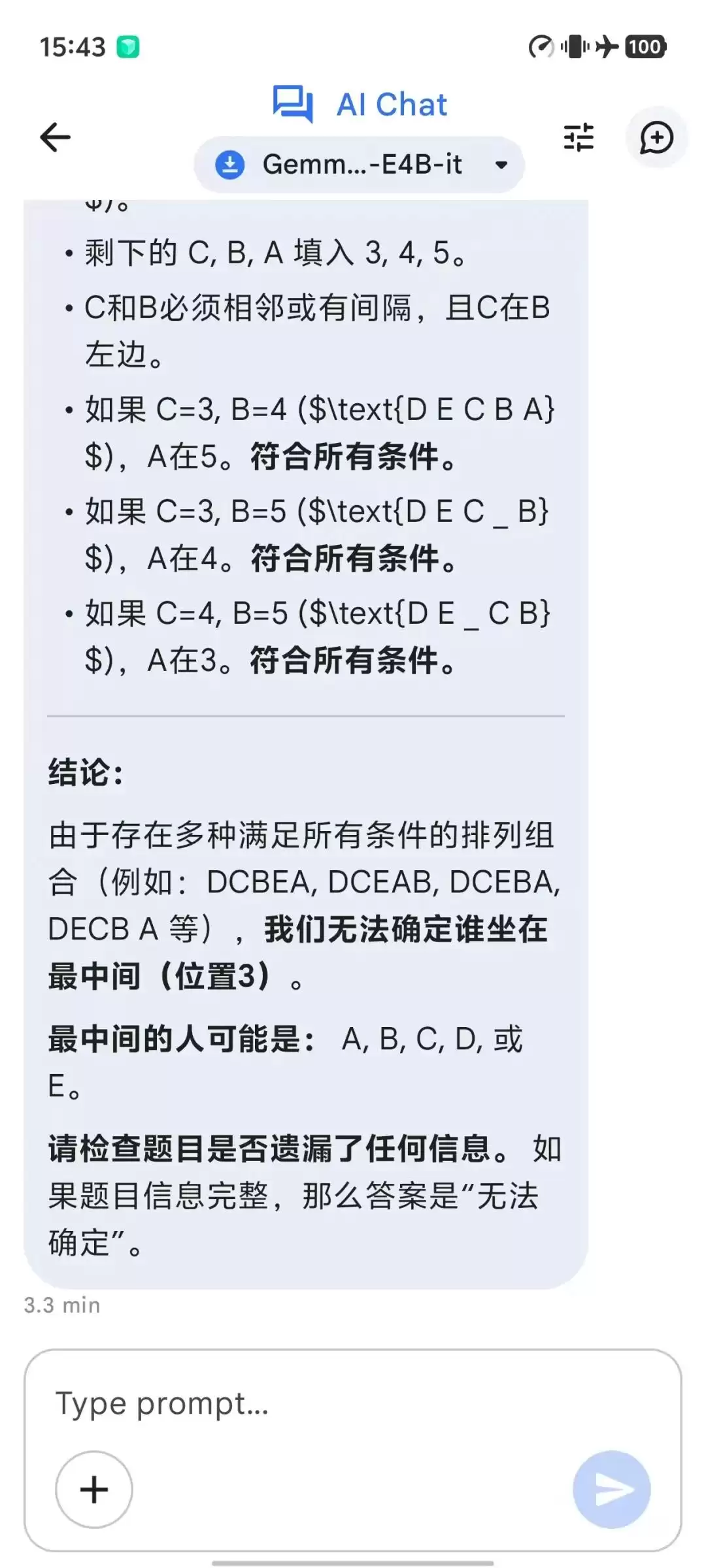

随后进行逻辑推理测试:“五人排坐,A不在最左,B在C右,D在E左,E不在最右,问谁在中间?”模型尝试逐步推理并排列组合,但最终未能给出正确答案,耗时3.3分钟。且在此期间应用无法后台运行,用户体验中断。

(图源:雷科技制图)

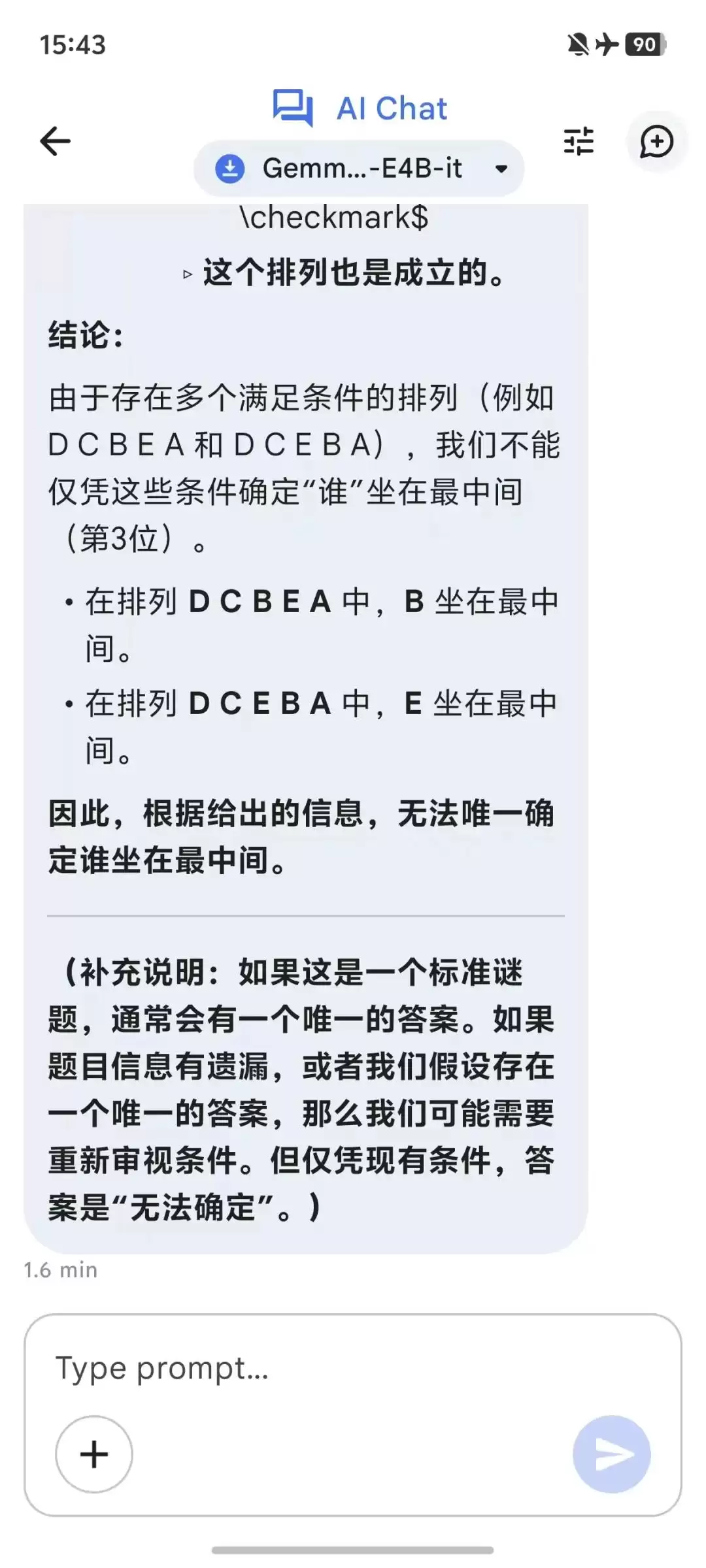

需要指出,逻辑错误并非千元机独有。在旗舰机X300 Pro上,同一模型同样给出了错误答案。但关键差异在于速度:X300 Pro仅用1.6分钟便完成了错误输出。

(图源:雷科技制图)

第三个测试为语义理解题:“洗车应该开车去还是走路去?”有趣的是,同一模型在不同硬件上产生了输出差异。Y500 Pro耗时2.5分钟后,给出了一个偏离常识的答案:“如果是为了‘洗车’而去,应该选择步行。”

(图源:雷科技制图)

而X300 Pro的回复虽经曲折推理,但最终回归常识:“若要去洗车,仍需开车前往。”

三轮文本测试清晰勾勒出Y500 Pro上Gemma 4 E4B的画像:响应速度极慢、输出冗长且错误率较高。唯一慰藉是运行过程中设备未明显发烫。

“慢”是核心痛点,平均每个问题需等待2-3分钟。这直接源于天玑7400的NPU算力天花板,限制了其每秒处理Token的数量。而高错误率,则与算力紧张导致的中间“思考”过程被压缩有关。在资源有限的情况下,模型可能被迫提前终止深层推理,转而快速生成文本,从而更易产生“幻觉”或逻辑谬误。

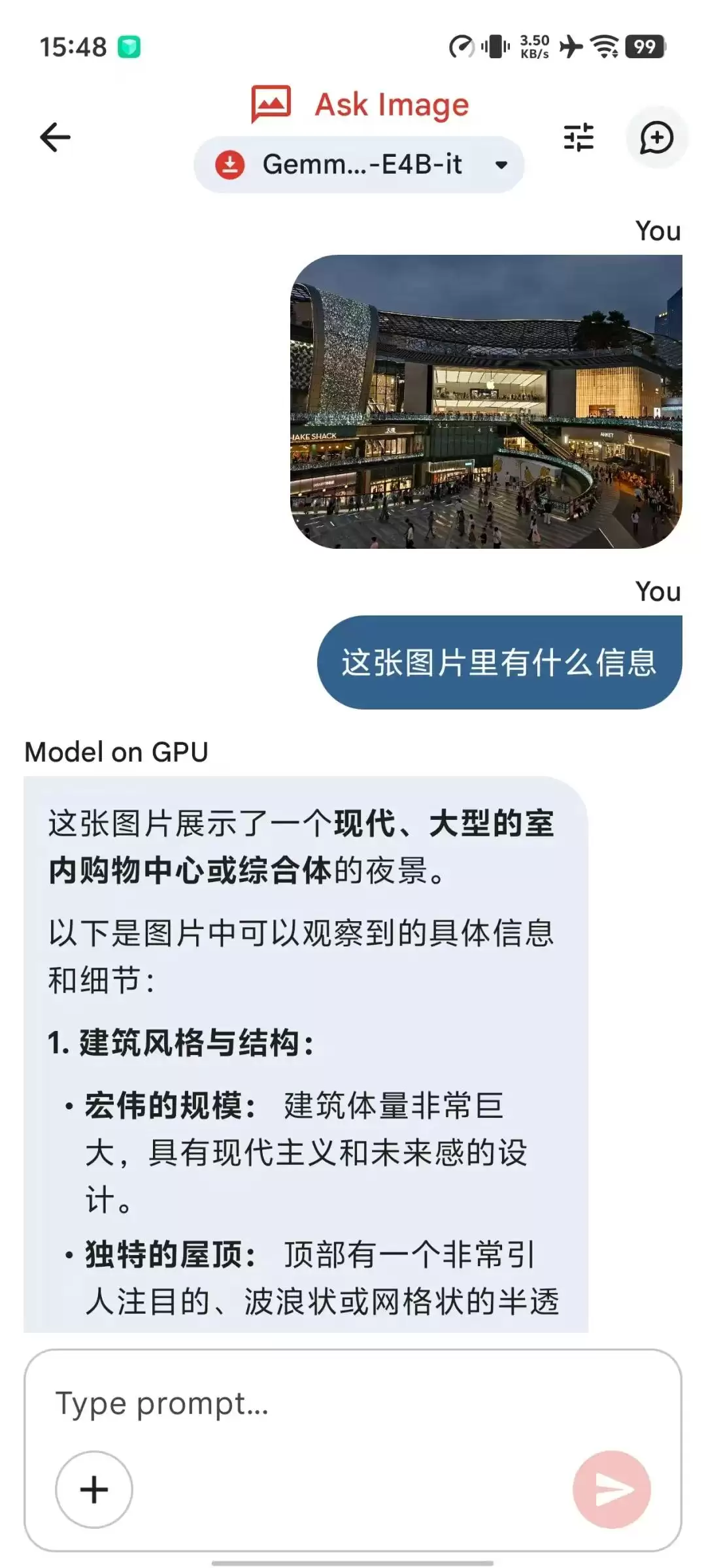

Gemma 4 E4B支持多模态输入,因此我们对其图像识别能力进行了测试。输入一张夜景购物中心照片并要求描述。

模型回答在整体场景描述上方向正确,涵盖了建筑规模与夜景氛围。但一个显著缺陷是:图中巨大的Apple Store标识被完全忽略,仅以“现代大型购物中心”概括。这表明,以E4B的参数量级,完成通用物体识别已属不易,要实现精准的品牌识别,需要关联庞大的视觉-知识库,这显然超出了其当前能力范围。

(图源:雷科技制图)

第二张测试图为普通绿植与地插喷头。这一次,模型完全“卡死”。加载动画持续旋转五分钟,未输出任何结果,且应用进程无法中断。实际上,图中物体只是一个简单的浇灌喷头。

(图源:雷科技制图)

作为对比,旗舰机X300 Pro仅用32秒便对同一图片做出回应,虽将喷头误识别为“小型传感器”,但至少提供了有效反馈。

(图源:雷科技制图)

综合来看,Y500 Pro上的Gemma 4 E4B并非完全失效,其在简单问答上仍可工作,且功耗控制尚可。但核心矛盾在于:作为本地模型,其响应速度严重影响了可用性。同时,当前“Google AI Edge Gallery”应用权限极为有限,除基础操作如开关手电筒外,几乎无法执行任何系统级自动化任务。

这就陷入了一个实用性质疑:在拥有高速网络的环境下,用户为何要放弃响应即时、能力更强的云端大模型,转而忍受一个缓慢且可能出错的本地版本?除非处于完全离线的极端场景,否则其当前价值确实有限。

实测表明,Gemma 4目前要达到“可用”的体验基线,确实依赖旗舰级硬件支撑。尽管仍有错误,但至少响应速度在可接受范围内。

那么,谷歌推出此应用的深层目标是什么?

观察应用内的“Mobile Actions”功能可窥见端倪:其设计初衷是将自然语言指令直接转化为系统操作,例如“创建日历事件”或“开启手电筒”。模型理解意图后,可调用系统API自动执行。这勾勒出清晰的演进路径:让AI成为系统级的交互中枢。

类似的自动化尝试已在高端市场展开。例如三星Galaxy S25系列的跨应用执行链,以及此前引发关注的“豆包手机”所演示的“手机自动驾驶”概念。

(图源:豆包手机助手)

但必须厘清一个关键事实:这些复杂的自动化任务,绝大多数并非完全由本地模型驱动。无论是三星、苹果还是其他厂商,其复杂任务链背后通常有云端算力作为协同支撑。

本质在于,本地模型的能力受其参数量严格制约。参数越小,任务处理能力越固定、越简单。而用户对AI的期待是无限且复杂的。因此,当前主流架构是“云边协同”:云端处理复杂计算与知识检索,本地则负责对实时性要求高或涉及隐私的轻量级任务,如实时语音转写、通知摘要等。

因此,谷歌这款应用更像是一次面向移动端的大规模技术试水。其策略是优先让模型在尽可能多的设备上运行起来,逐步开放系统权限,同时等待芯片算力的普遍提升。

然而,真正的挑战在于产业链的协同动力。联发科、高通在发布旗舰芯片时,总会强调NPU算力的巨大飞跃。但对于主导销量的中低端芯片,市场策略核心是成本与能效平衡,AI算力往往并非优先升级项。

因此,普通用户能否用上体验良好的本地AI,并非谷歌一己之力可决定。它需要芯片厂商将足够的AI算力下放到主流价位段,需要手机厂商进行深度的系统层优化与整合。谷歌在应用生态层面打开了可能性,但后续推进,取决于硬件产业链是否愿意跟进,以及市场是否真正愿意为这部分增量体验买单。毕竟,真正的销量基石,始终在于主流市场。

菜鸟下载发布此文仅为传递信息,不代表菜鸟下载认同其观点或证实其描述。