openclaw配置本地qwen模型

将AI带回您的私人书房:零成本本地化部署Qwen大模型 渴望在个人计算机上部署一个功能完

将AI带回您的私人书房:零成本本地化部署Qwen大模型

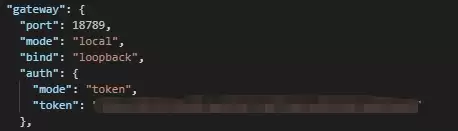

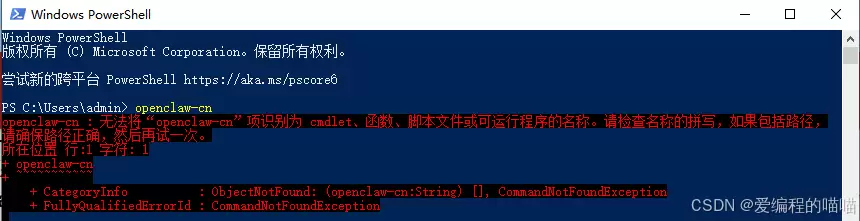

渴望在个人计算机上部署一个功能完备的语言模型,同时追求对数据主权的完全掌控?本地化部署的实现路径,远比多数人预想的更为直接。其核心架构是:采用Ollama作为模型运行时管理器,并通过OpenClaw工具经由标准化接口对其进行调用。此方案不仅让您能充分利用Qwen模型的智能能力,更确保整个流程免费、支持离线运行,所有数据处理均在您的本地环境中完成。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

核心实施路径

为达成此目标,建议遵循一个结构清晰的“五步走”实施框架。其中每个环节都紧密衔接,为后续步骤奠定必要基础。

第一步:部署Ollama(构建本地AI运行环境)

Ollama是一款高效的模型管理工具,它能将复杂的模型部署流程简化为数条终端命令。首先,请根据您的操作系统选择对应的安装方法。

Windows用户:

- 访问Ollama官方网站(ollama.com/download)下载标准的

OllamaSetup.exe安装程序。 - 如同安装常规软件一样运行该程序,安装向导将自动完成所有环境变量的配置工作。

- 安装结束后,请打开PowerShell或命令提示符,输入

ollama --version命令。若终端成功显示版本号,则表明安装已顺利完成。

macOS用户:

对于习惯使用Homebrew包管理器的用户,仅需两行命令即可完成。在终端应用中,依次执行:

brew install ollama

brew services start ollama

Linux (如 Ubuntu/Debian) 用户:

在Linux系统下的安装通常最为简洁。于终端中,使用官方提供的安装脚本以一键完成部署并设置为系统服务:

curl -fsSL https://ollama.com/install.sh | sh

systemctl enable --now ollama

关键提示:无论采用何种操作系统,Ollama在安装完成后默认会自动启动一个本地服务,并监听

http://localhost:11434这一地址与端口。此端点至关重要,它是后续OpenClaw工具连接本地模型的核心枢纽。

第二步:选择与下载适配的Qwen模型

本地运行环境就绪后,下一步便是引入核心的“智能引擎”——大语言模型。Qwen系列提供了从轻量到高性能的多种规格版本,具体选择哪一款,应主要依据您的计算机硬件配置,特别是显卡显存容量与系统可用内存。

菜鸟下载发布此文仅为传递信息,不代表菜鸟下载认同其观点或证实其描述。

相关文章

更多>>热门游戏

更多>>热点资讯

更多>>热门排行

更多>>- 天道仙尊游戏版本排行榜-天道仙尊游戏合集-2023天道仙尊游戏版本推荐

- 灵汐缘2手游2023排行榜前十名下载_好玩的灵汐缘2手游大全

- 口袋觉醒题材手游排行榜下载-有哪些好玩的口袋觉醒题材手机游戏推荐

- 龙之神途手游排行榜-龙之神途手游下载-龙之神途游戏版本大全

- 梦中的你手游排行榜-梦中的你手游下载-梦中的你游戏版本大全

- 永恒战士排行榜下载大全-2023最好玩的永恒战士前十名推荐

- 炎黄大陆手游排行榜-炎黄大陆手游下载-炎黄大陆游戏版本大全

- 山海夜行手游2023排行榜前十名下载_好玩的山海夜行手游大全

- 类似白蛇问仙的手游排行榜下载-有哪些好玩的类似白蛇问仙的手机游戏排行榜

- 荒岛生存最新排行榜-荒岛生存手游免费版下载-荒岛生存免费破解版下载

- 圣武逍遥手游2023排行榜前十名下载_好玩的圣武逍遥手游大全

- 一念永恒最新排行榜-一念永恒手游免费版下载-一念永恒免费破解版下载

![[deepin] 搭建 openclaw](https://www.cn486.com/uploadfile/2026/0401/470637e2be4d0ef8b2c9d7b6cb9435a3.webp)