Openclaw标准安装 配置本地模型Ollama

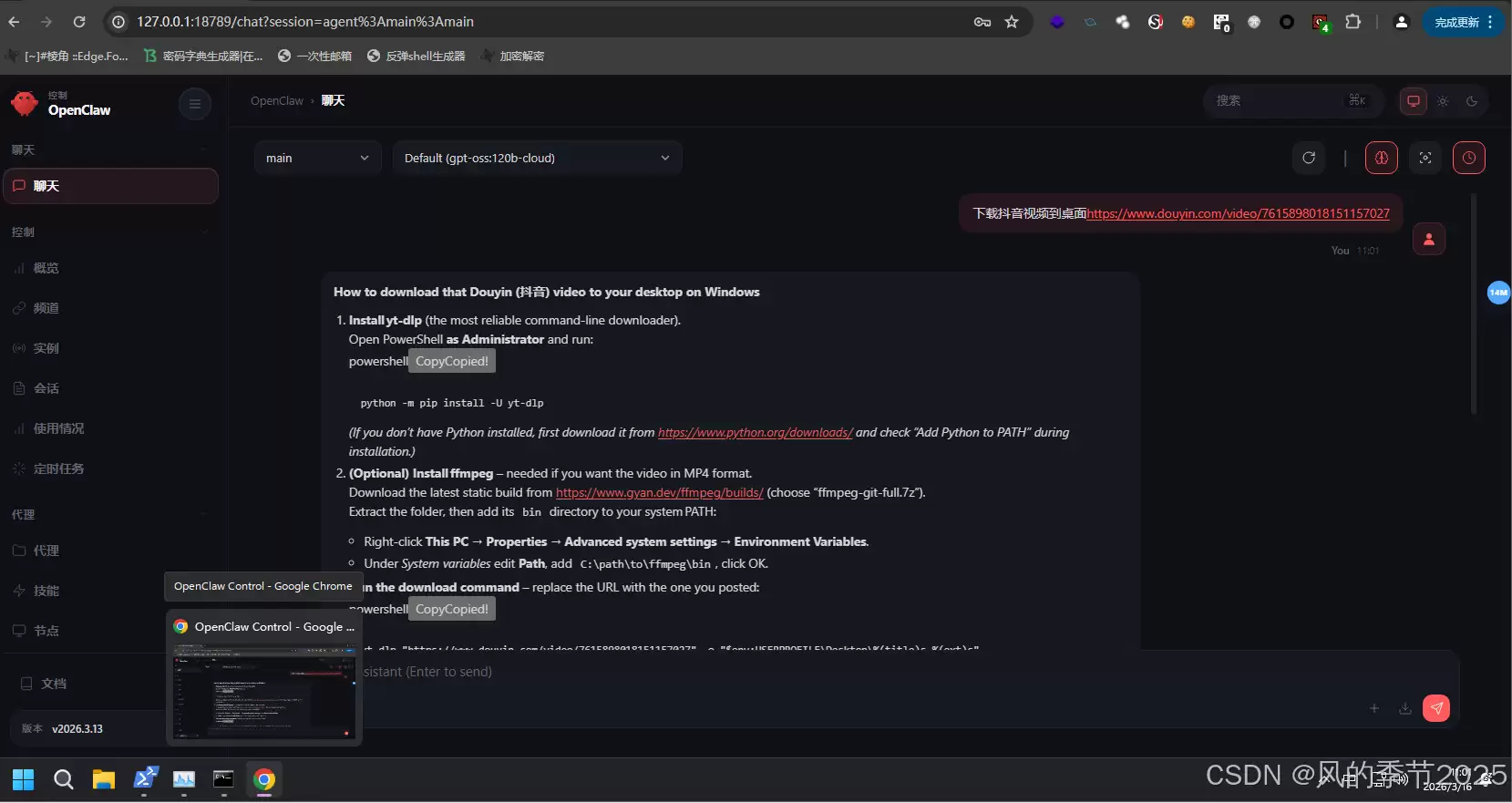

OpenClaw本地模型配置:Ollama集成简明教程 通过OpenClaw与本地Ollama模型集成,您可以在安全、

OpenClaw本地模型配置:Ollama集成简明教程

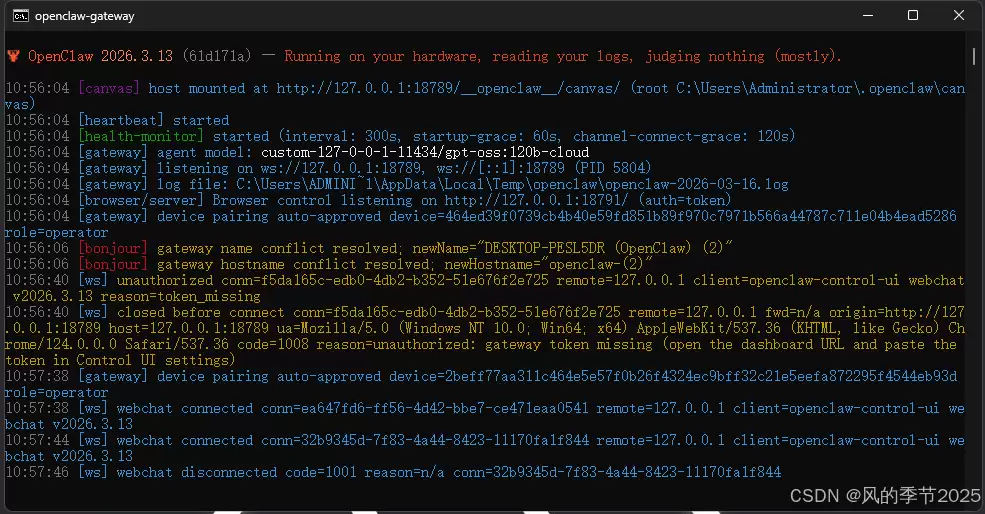

通过OpenClaw与本地Ollama模型集成,您可以在安全、私有的环境中部署AI助手。本指南将引导您完成配置的核心步骤。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

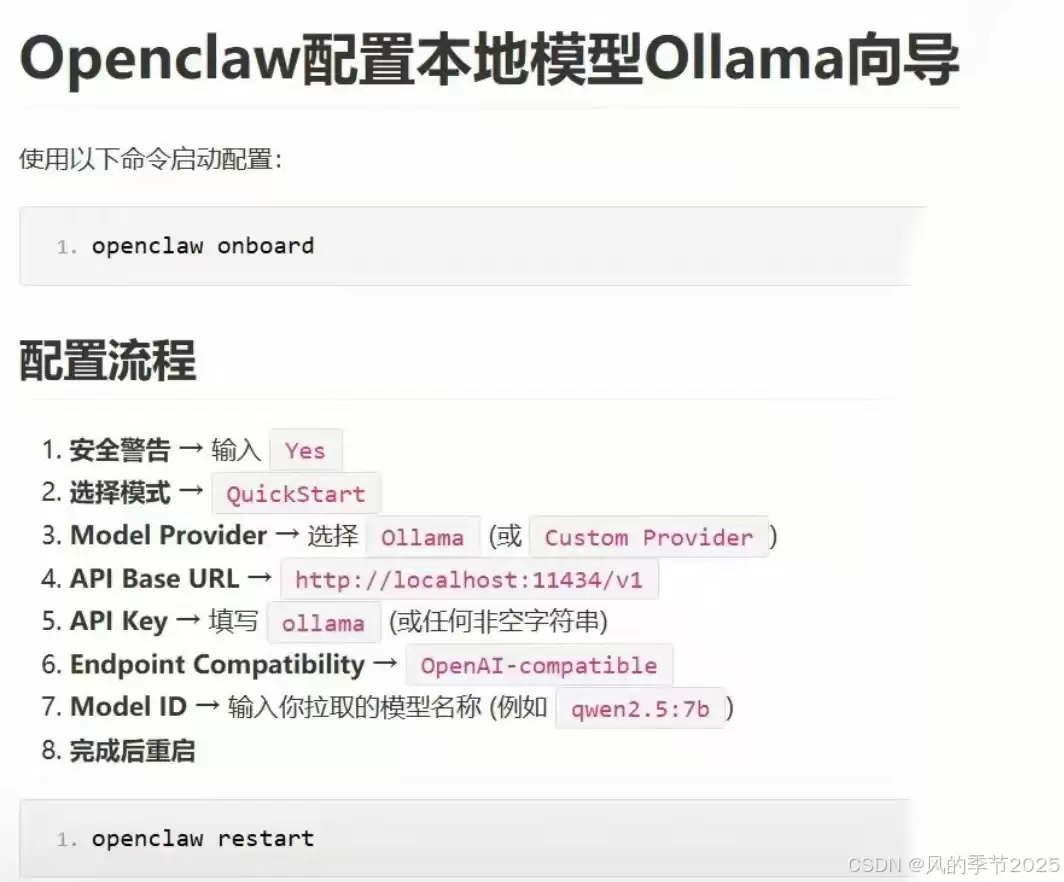

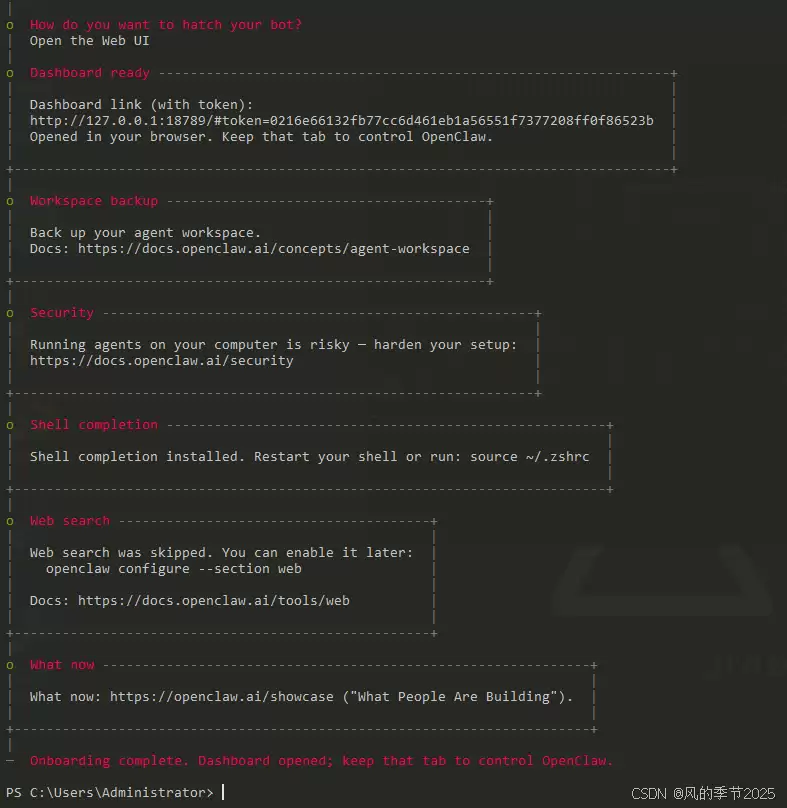

初始化配置

在终端执行以下命令,启动配置向导:

openclaw onboard

分步配置参数解析

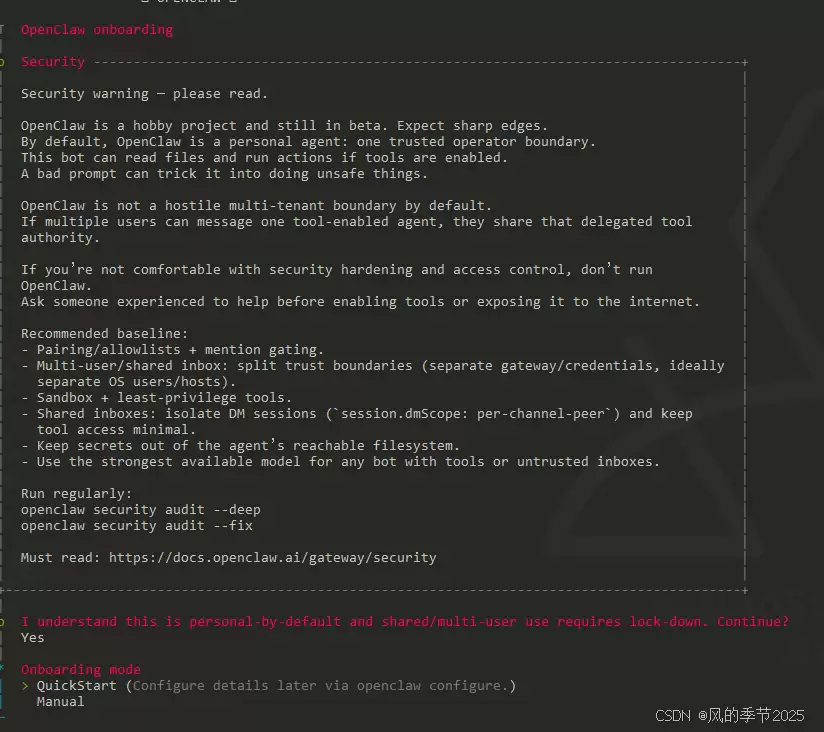

跟随命令行提示,准确输入以下关键参数。每一步都直接影响Ollama的API连接成功率。

1. 系统安全提示确认:输入 "Yes" 授权继续配置

2. 部署模式选择:为快速验证,选择 "QuickStart" 方案

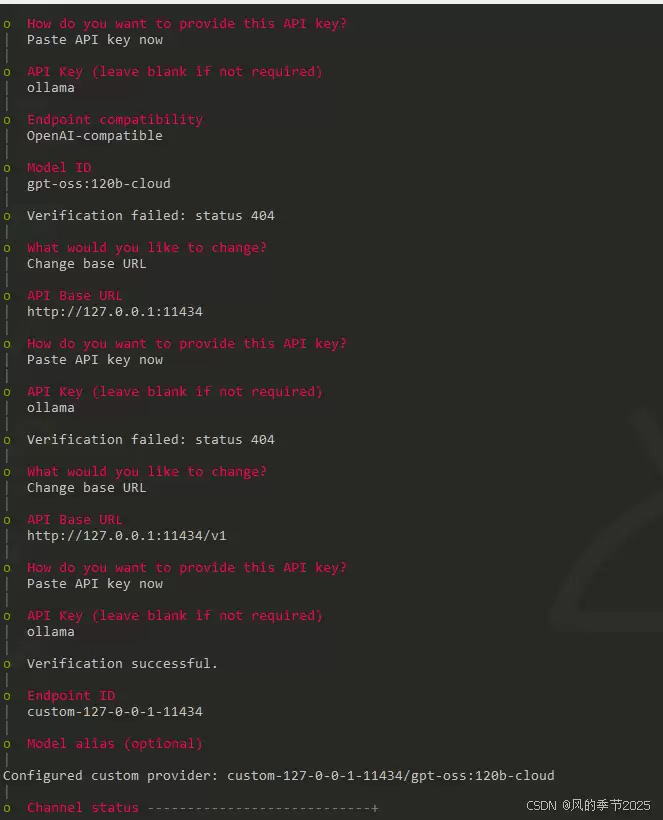

3. 模型供应商设置:指定为 "Ollama"(高级用户可选“Custom Provider”进行自定义)

4. API基础地址配置:填入本地端点 http://localhost:11434/v1

5. API密钥验证:输入 "ollama" 作为密钥(或任一非空字符串)

6. 接口兼容性选择:设定为 "OpenAI-compatible" 以匹配标准协议

7. 模型标识符指定:输入您已通过Ollama拉取的模型名称,例如“qwen2.5:7b”

使配置生效

全部参数设置完毕后,必须重启OpenClaw服务,以加载新的Ollama连接器。

openclaw restart

菜鸟下载发布此文仅为传递信息,不代表菜鸟下载认同其观点或证实其描述。

相关文章

更多>>热门游戏

更多>>热点资讯

更多>>热门排行

更多>>- 多种热门耐玩的代号邪神破解版游戏下载排行榜-代号邪神破解版下载大全

- 江湖故人游戏版本排行榜-江湖故人游戏合集-2023江湖故人游戏版本推荐

- 类似千古长歌的游戏排行榜_有哪些类似千古长歌的游戏

- 长生物语游戏版本排行榜-长生物语游戏合集-2023长生物语游戏版本推荐

- 剑客物语最新排行榜-剑客物语手游免费版下载-剑客物语免费破解版下载

- 有翡题材手游排行榜下载-有哪些好玩的有翡题材手机游戏推荐

- 裂天之刃手游排行榜-裂天之刃手游下载-裂天之刃游戏版本大全

- 龙之神剑ios手游排行榜-龙之神剑手游大全-有什么类似龙之神剑的手游

- 龙战于野ios手游排行榜-龙战于野手游大全-有什么类似龙战于野的手游

- 疯子医生ios手游排行榜-疯子医生手游大全-有什么类似疯子医生的手游

- 云正仙途游戏版本排行榜-云正仙途游戏合集-2023云正仙途游戏版本推荐

- 剑歌轩辕手游排行榜-剑歌轩辕手游下载-剑歌轩辕游戏版本大全