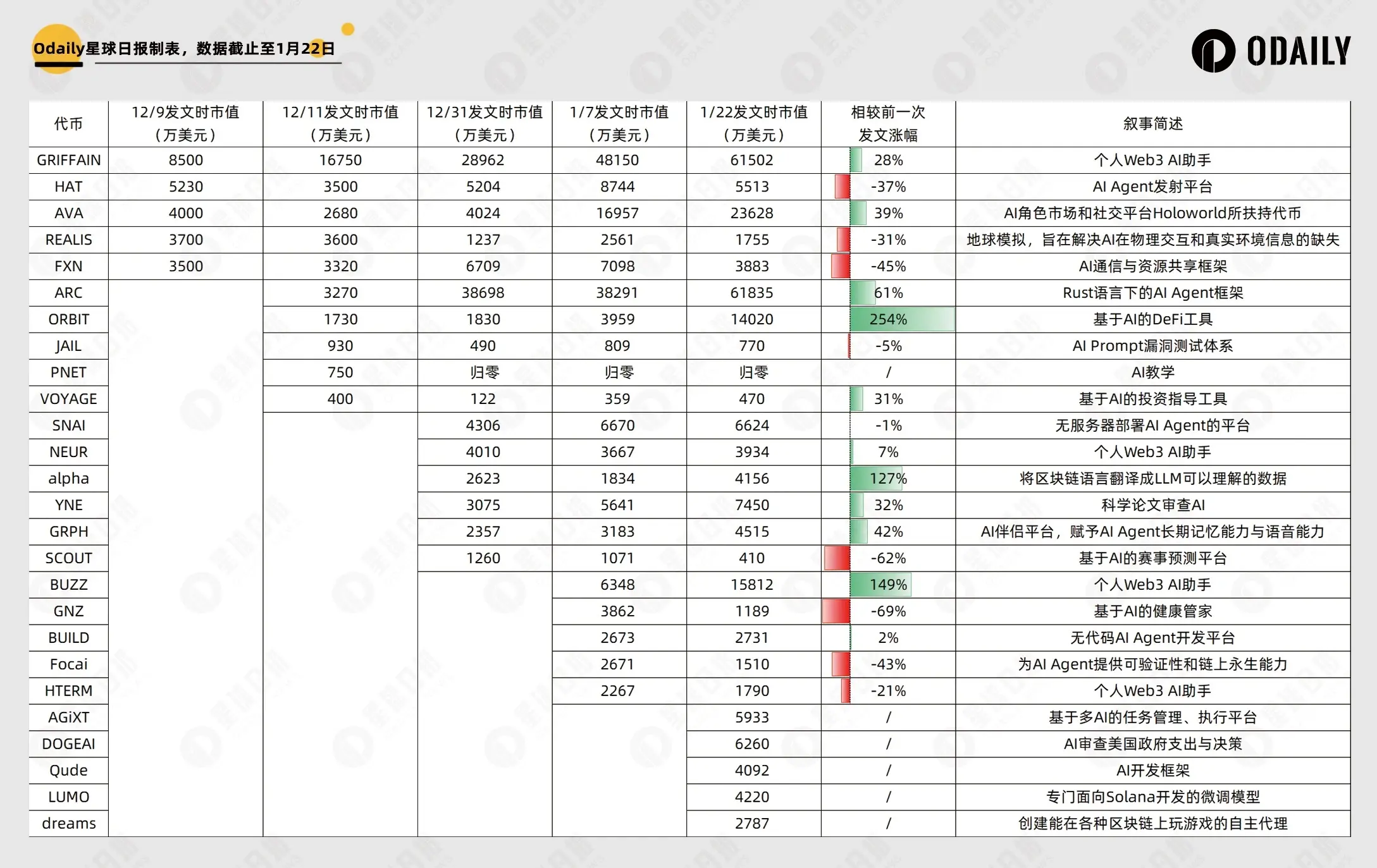

【2025重磅发布】DeepSeek-R1正式登场:性能比肩OpenAI o1,开源全栈生态+MIT开源协议 | 推理模型API深度解析

【2025重磅发布】DeepSeek-R1正式登场:性能比肩OpenAI o1,开源全栈生态+MIT开源协议 | 推理

【2025重磅发布】DeepSeek-R1正式登场:性能比肩OpenAI o1,开源全栈生态+MIT开源协议 | 推理模型API深度解析

2025年1月20日,人工智能领域迎来里程碑式突破!深度求索(deepseek)正式发布新一代推理大模型deepseek-r1,不仅实现与openai最新o1正式版的性能对标,更以全栈开放的生态布局引发行业震动。作为首个遵循mit license开源协议的高性能推理模型,r1的发布将如何重构ai开发者的技术生态?其独创的"思维链api接口"又会给企业级应用带来哪些革新?

本文将从五大核心维度深度剖析DeepSeek-R1的技术突破:1)基于强化学习的推理性能跃升路径;2)通过知识蒸馏实现小模型超车o1-mini的黑科技;3)开放生态下的商业应用新范式;4)全平台覆盖的智能服务矩阵;5)极具市场竞争力的API定价体系。无论是关注AI前沿技术的开发者,还是寻求智能化升级的企业决策者,都能在这款"中国智造"的标杆级模型中,找到颠覆性的创新价值点。

【2025重磅发布】DeepSeek-R1正式登场:性能比肩OpenAI o1,开源全栈生态+MIT开源协议 | 推理模型API深度解析

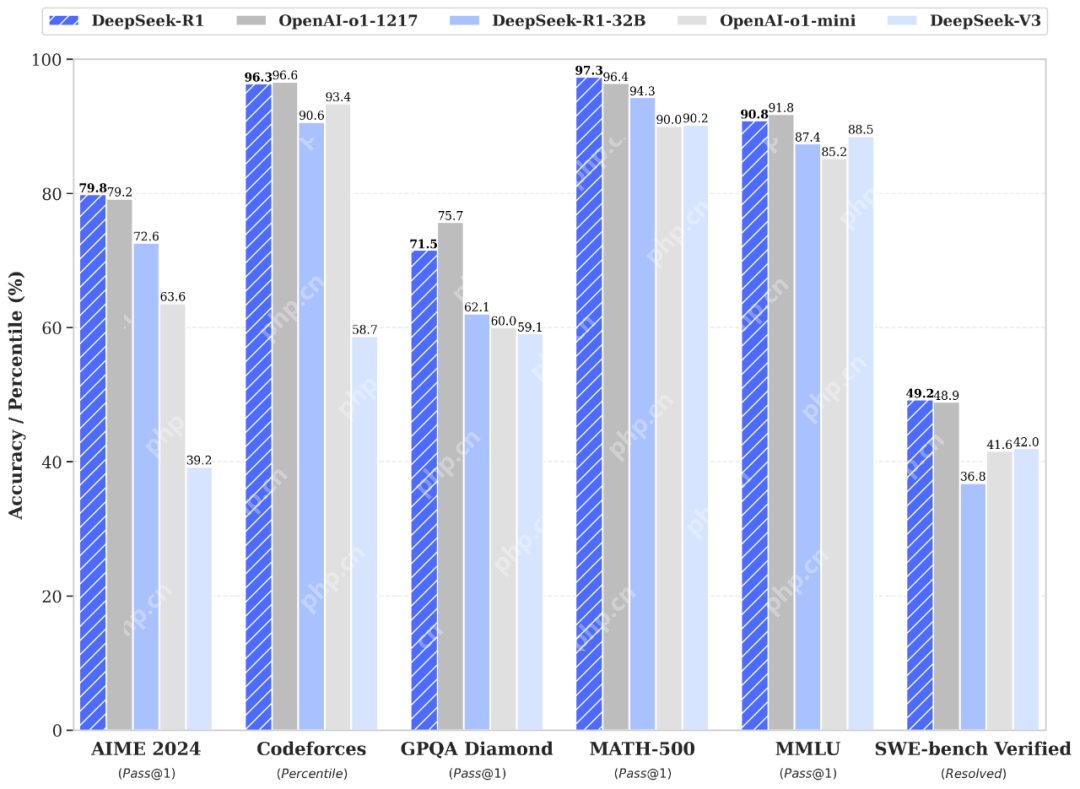

【2025重磅发布】DeepSeek-R1正式登场:性能比肩OpenAI o1,开源全栈生态+MIT开源协议 | 推理模型API深度解析DeepSeek-R1 在后训练阶段大规模使用了强化学习技术,在仅有极少标注数据的情况下,极大提升了模型推理能力。在数学、代码、自然语言推理等任务上,性能比肩 OpenAI o1 正式版。

img

img在此,我们将 DeepSeek-R1 训练技术全部公开,以期促进技术社区的充分交流与创新协作。

论文链接: https://github.com/deepseek-ai/DeepSeek-R1/blob/main/DeepSeek_R1.pdf

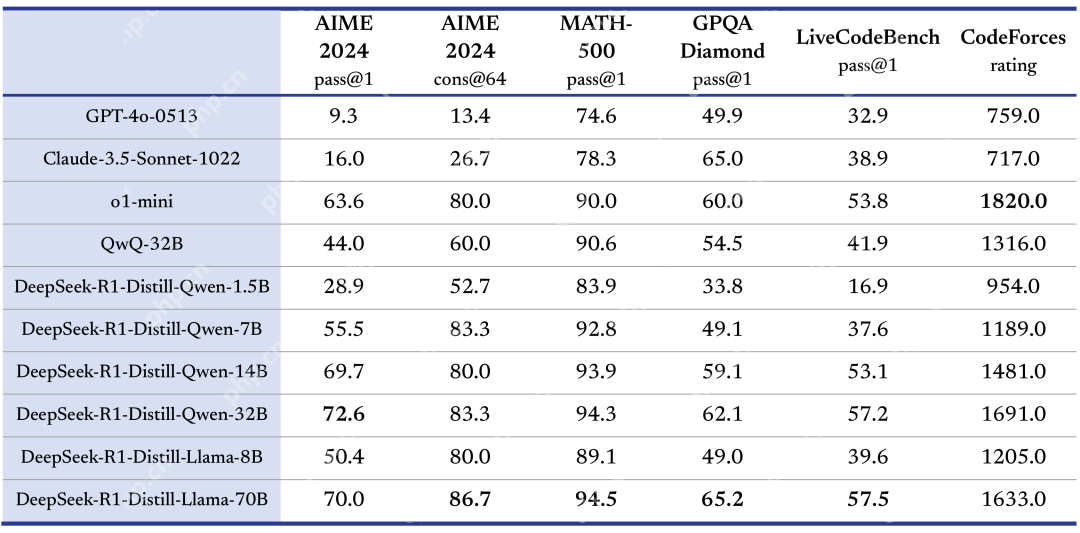

蒸馏小模型超越 OpenAI o1-mini我们在开源 DeepSeek-R1-Zero 和 DeepSeek-R1 两个 660B 模型的同时,通过 DeepSeek-R1 的输出,蒸馏了 6 个小模型开源给社区,其中 32B 和 70B 模型在多项能力上实现了对标 OpenAI o1-mini 的效果。

img

imgHuggingFace 链接: https://huggingface.co/deepseek-ai

img

img为了推动和鼓励开源社区以及行业生态的发展,在发布并开源 R1 的同时,我们同步在协议授权层面也进行了如下调整:

模型开源 License 统一使用 MIT。我们曾针对大模型开源的特点,参考当前行业的通行实践,特别引入 DeepSeek License 为开源社区提供授权,但实践表明非标准的开源 License 可能反而增加了开发者的理解成本。为此,此次我们的开源仓库(包括模型权重)统一采用标准化、宽松的 MIT License,完全开源,不限制商用,无需申请。产品协议明确可“模型蒸馏”。为了进一步促进技术的开源和共享,我们决定支持用户进行“模型蒸馏”。我们已更新线上产品的用户协议,明确允许用户利用模型输出、通过模型蒸馏等方式训练其他模型。App与网页端登录DeepSeek官网或官方App,打开“深度思考”模式,即可调用最新版 DeepSeek-R1 完成各类推理任务。

img

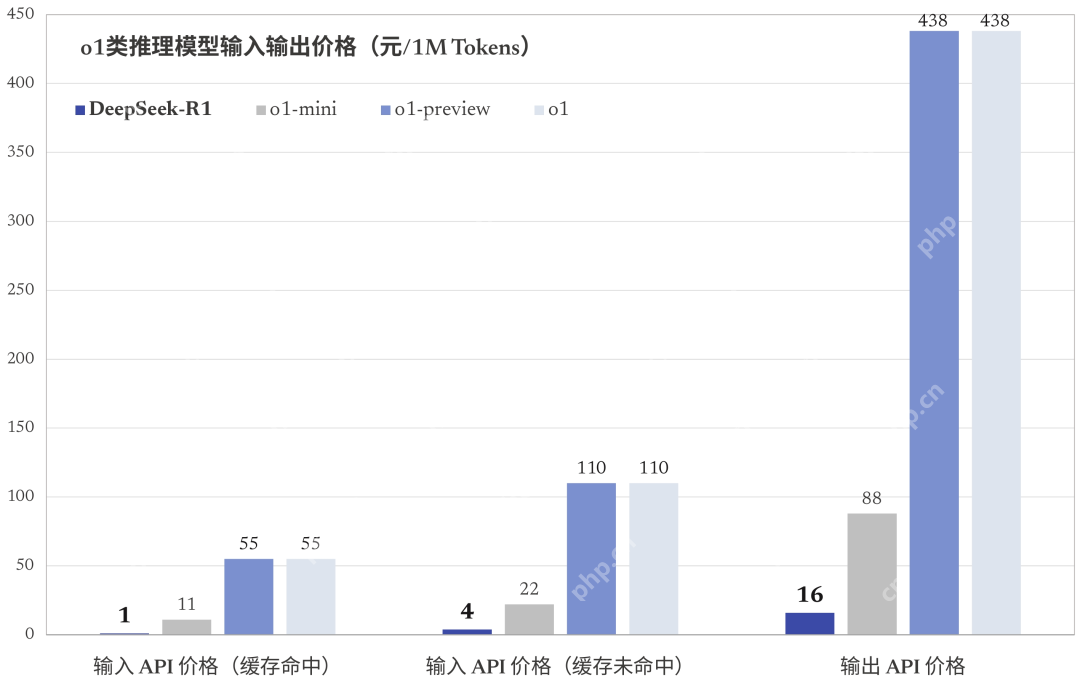

imgDeepSeek-R1 API 服务定价为每百万输入 tokens 1 元(缓存命中)/ 4 元(缓存未命中),每百万输出 tokens 16 元。

img

img img

img详细的 API 调用指南请参考官方文档: https://api-docs.deepseek.com/zh-cn/guides/reasoning_model

推理模型 (deepseek-reasoner)deepseek-reasoner 是 DeepSeek 推出的推理模型。在输出最终回答之前,模型会先输出一段思维链内容,以提升最终答案的准确性。我们的 API 向用户开放 deepseek-reasoner 思维链的内容,以供用户查看、展示、蒸馏使用。

在使用 deepseek-reasoner 时,请先升级 OpenAI SDK 以支持新参数。

代码语言:javascript代码运行次数:0运行复制pip3 install -U openai登录后复制API 参数输入参数: max_tokens:最终回答的最大长度(不含思维链输出),默认为 4K,最大为 8K。请注意,思维链的输出最多可以达到 32K tokens,控思维链的长度的参数(reasoning_effort)将会在近期上线。输出字段: reasoning_content:思维链内容,与 content 同级,访问方法见访问样例content:最终回答内容上下文长度:API 最大支持 64K 上下文,输出的 reasoning_content 长度不计入 64K 上下文长度中支持的功能:对话补全,对话前缀续写 (Beta)不支持的功能:Function Call、Json Output、FIM 补全 (Beta)不支持的参数:temperature、top_p、presence_penalty、frequency_penalty、logprobs、top_logprobs。请注意,为了兼容已有软件,设置 temperature、top_p、presence_penalty、frequency_penalty 参数不会报错,但也不会生效。设置 logprobs、top_logprobs 会报错。上下文拼接

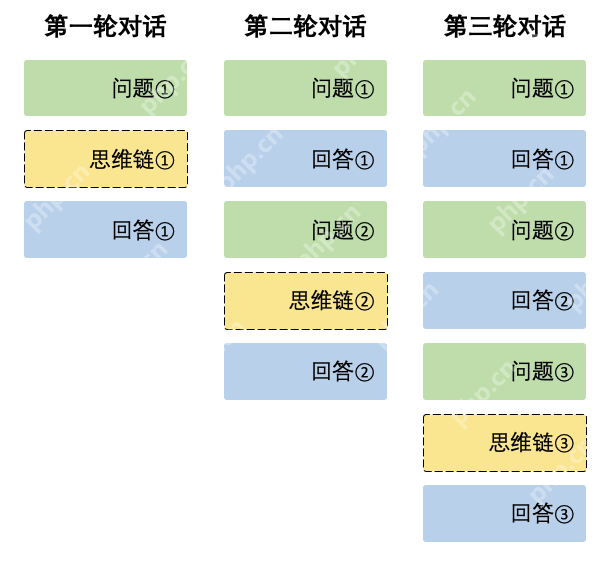

在每一轮对话过程中,模型会输出思维链内容(reasoning_content)和最终回答(content)。在下一轮对话中,之前轮输出的思维链内容不会被拼接到上下文中,如下图所示:

img

img请注意,如果您在输入的 messages 序列中,传入了reasoning_content,API 会返回 400 错误。因此,请删除 API 响应中的 reasoning_content 字段,再发起 API 请求,方法如访问样例所示。

访问样例下面的代码以 Python 语言为例,展示了如何访问思维链和最终回答,以及如何在多轮对话中进行上下文拼接。

流式代码语言:javascript代码运行次数:0运行复制from openai import OpenAIclient = OpenAI(api_key="登录后复制非流式代码语言:javascript代码运行次数:0运行复制", base_url="https://api.deepseek.com")# Round 1messages = [{"role": "user", "content": "9.11 and 9.8, which is greater?"}]response = client.chat.completions.create( model="deepseek-reasoner", messages=messages, stream=True)reasoning_content = ""content = ""for chunk in response: if chunk.choices[0].delta.reasoning_content: reasoning_content += chunk.choices[0].delta.reasoning_content else: content += chunk.choices[0].delta.content# Round 2messages.append({"role": "assistant", "content": content})messages.append({'role': 'user', 'content': "How many Rs are there in the word 'strawberry'?"})response = client.chat.completions.create( model="deepseek-reasoner", messages=messages, stream=True)# ...

from openai import OpenAIclient = OpenAI(api_key="登录后复制总结", base_url="https://api.deepseek.com")# Round 1messages = [{"role": "user", "content": "9.11 and 9.8, which is greater?"}]response = client.chat.completions.create( model="deepseek-reasoner", messages=messages)reasoning_content = response.choices[0].message.reasoning_contentcontent = response.choices[0].message.content# Round 2messages.append({'role': 'assistant', 'content': content})messages.append({'role': 'user', 'content': "How many Rs are there in the word 'strawberry'?"})response = client.chat.completions.create( model="deepseek-reasoner", messages=messages)# ...

DeepSeek-R1的横空出世,标志着国产大模型在关键技术领域实现质的突破。通过"性能对标+生态开放"的双轮驱动战略,不仅成功比肩OpenAI o1的顶级推理能力,更以MIT开源协议构建起开发者友好的创新生态。其独创的思维链API接口与动态蒸馏技术,为企业降本增效提供了全新解决方案。

随着模型权重和训练框架的全面开放,我们有理由预见:在R1的技术底座上,将涌现出更多垂直领域的智能应用。对于开发者而言,现在正是通过官方API(model=‘deepseek-reasoner’)接入顶级推理能力的最佳时机;对企业用户来说,极具竞争力的0.002美元/千token定价策略,将大幅降低AI部署成本。这场由DeepSeek-R1引发的智能革命,正在开启通用人工智能普惠化的新纪元。

(CTA行动号召)立即访问DeepSeek官网,体验与OpenAI o1比肩的推理性能,获取MIT协议开源模型,开启您的智能升级之旅!

菜鸟下载发布此文仅为传递信息,不代表菜鸟下载认同其观点或证实其描述。

相关文章

更多>>热门游戏

更多>>热点资讯

更多>>热门排行

更多>>- 猪猪公寓排行榜下载大全-2023最好玩的猪猪公寓前十名推荐

- 核心神器ios手游排行榜-核心神器手游大全-有什么类似核心神器的手游

- 魔月永恒游戏排行-魔月永恒所有版本-魔月永恒游戏合集

- 2023秘境神塔手游排行榜-秘境神塔手游2023排行榜前十名下载

- 类似剑来天下的游戏排行榜_有哪些类似剑来天下的游戏

- 永恒之塔最新排行榜-永恒之塔手游免费版下载-永恒之塔免费破解版下载

- 奇迹muios手游排行榜-奇迹mu手游大全-有什么类似奇迹mu的手游

- 冰雪斩龙最新排行榜-冰雪斩龙手游免费版下载-冰雪斩龙免费破解版下载

- 仙侠风云游戏排行-仙侠风云所有版本-仙侠风云游戏合集

- 热血之光手游2023排行榜前十名下载_好玩的热血之光手游大全

- 多种热门耐玩的绝园少女破解版游戏下载排行榜-绝园少女破解版下载大全

- 极上红颜手游排行榜-极上红颜手游下载-极上红颜游戏版本大全