模型训练

在上一篇关于提示工程(prompt engineering)的文章中,我们讨论了提示的概念。提示通过改变语

在上一篇关于提示工程(prompt engineering)的文章中,我们讨论了提示的概念。提示通过改变语言模型(llm)的输入来影响其输出,提示对词汇的分布极为敏感,即使是微小的变化也可能导致显著的差异。虽然通过提示可以调整模型在词汇上的分布,但当我们需要将一个在特定领域训练的模型应用到全新领域时,仅靠提示是不够的。与此相反,训练过程则涉及到直接修改模型的参数。简单来说,训练过程是通过向模型提供输入,让模型预测输出,并根据预测结果调整参数,使模型的下一次输出更接近正确答案。

免费影视、动漫、音乐、游戏、小说资源长期稳定更新! 👉 点此立即查看 👈

模型训练是改变词汇分布的关键方法。从零开始训练一个模型需要巨大的成本,对于大多数用户来说这几乎是不可能的任务。因此,用户通常会选择一个在大规模数据上预训练的模型进行进一步的训练。这些预训练模型通常是在通用任务或数据集上训练的,具备学习一般特征和模式的能力。常见的训练类型包括Fine-tuning(微调)、Parameter-Efficient Fine-Tuning(参数高效微调)、Soft Prompting(软提示)以及Continue Pre-training(持续预训练)等。

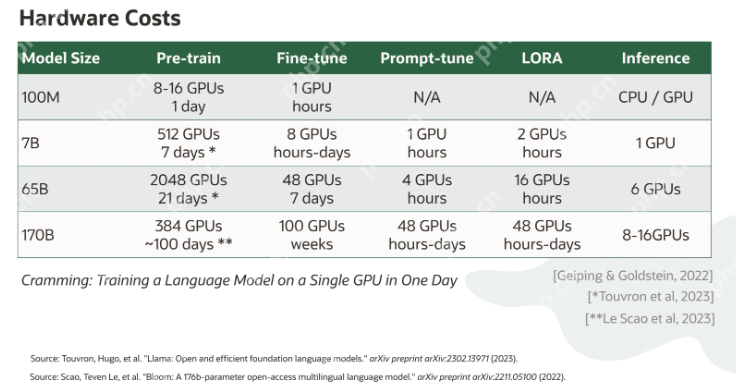

Fine-tuning(微调):使用预训练模型(如BERT)和带标签的数据集对模型的所有参数进行调整,这是经典的机器学习训练方法。Parameter-Efficient Fine-Tuning(参数高效微调):通过隔离一小部分参数进行训练,或向模型中添加新参数,可以降低训练成本(例如,LORA)。Soft Prompting(软提示):将参数添加到提示中,可以将其视为使用专门的引号将词汇添加到模型中,以执行特定任务。与传统提示不同,这些专门词汇的参数是在训练过程中随机初始化并迭代微调的。Continue Pre-training(持续预训练):类似于微调,但不需要使用标签数据。在持续预训练期间,输入任何类型的数据,并要求模型不断预测下一个词汇。如果尝试将模型适应一个新的领域(例如,从一般文本到专门的科学领域),通过持续预训练,预测来自该专业科学领域的数百万句中的下一个词汇可以非常有效。模型训练需要消耗大量的硬件资源,下面是基于OCI(Oracle Cloud Infrastructure)的不同训练方法的硬件成本示例:

通过以上方法和成本分析,用户可以根据自己的需求和预算选择最合适的训练策略。

菜鸟下载发布此文仅为传递信息,不代表菜鸟下载认同其观点或证实其描述。

相关文章

更多>>热门游戏

更多>>热点资讯

更多>>热门排行

更多>>- 天道仙尊游戏版本排行榜-天道仙尊游戏合集-2023天道仙尊游戏版本推荐

- 灵汐缘2手游2023排行榜前十名下载_好玩的灵汐缘2手游大全

- 口袋觉醒题材手游排行榜下载-有哪些好玩的口袋觉醒题材手机游戏推荐

- 龙之神途手游排行榜-龙之神途手游下载-龙之神途游戏版本大全

- 梦中的你手游排行榜-梦中的你手游下载-梦中的你游戏版本大全

- 永恒战士排行榜下载大全-2023最好玩的永恒战士前十名推荐

- 炎黄大陆手游排行榜-炎黄大陆手游下载-炎黄大陆游戏版本大全

- 山海夜行手游2023排行榜前十名下载_好玩的山海夜行手游大全

- 类似白蛇问仙的手游排行榜下载-有哪些好玩的类似白蛇问仙的手机游戏排行榜

- 荒岛生存最新排行榜-荒岛生存手游免费版下载-荒岛生存免费破解版下载

- 圣武逍遥手游2023排行榜前十名下载_好玩的圣武逍遥手游大全

- 一念永恒最新排行榜-一念永恒手游免费版下载-一念永恒免费破解版下载