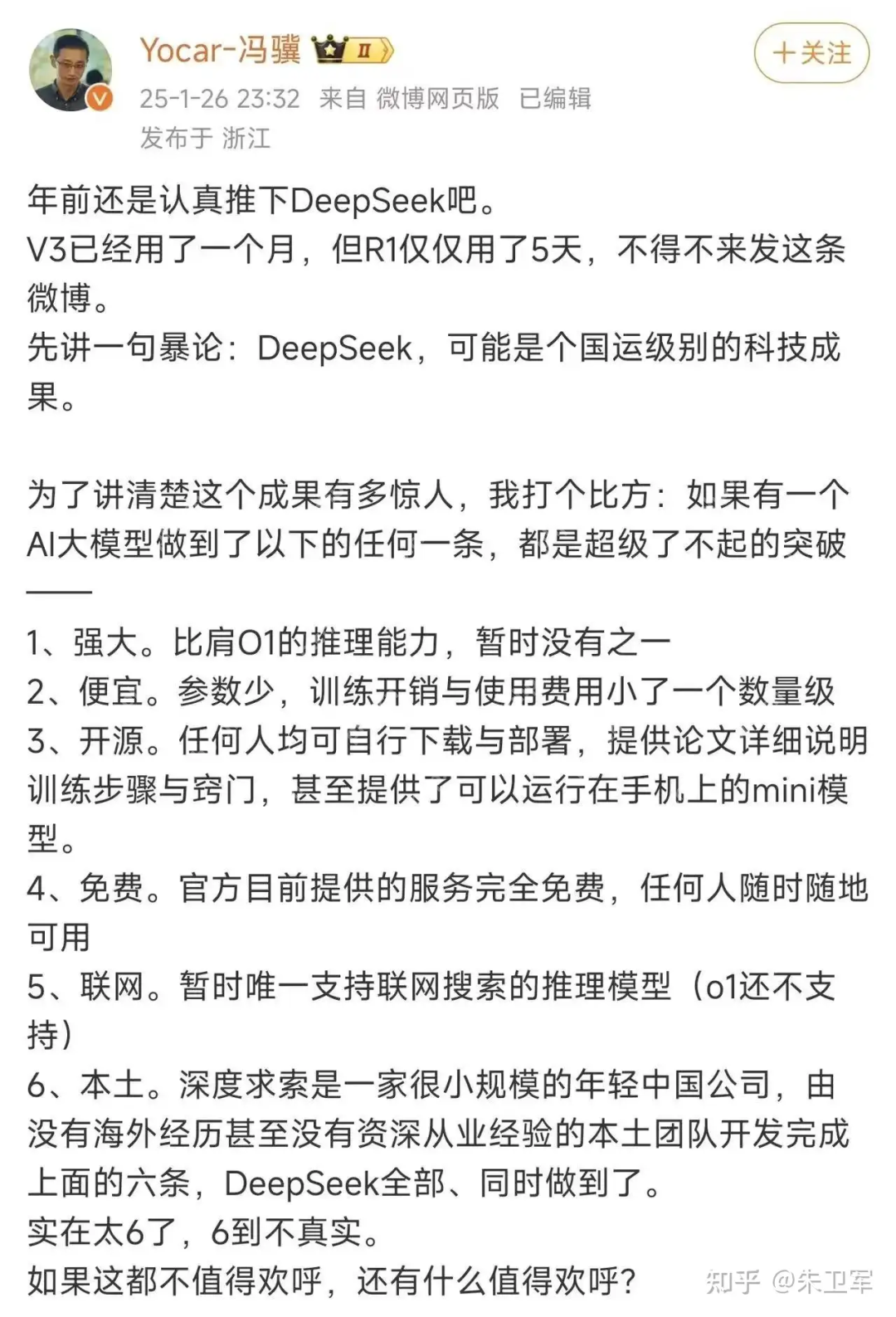

聊聊Deepseek,为什么冯骥说它是国运级别科技成果?

最近,全球各路大佬纷纷关注deepseek,黑神话悟空的创始人冯骥盛赞其为“国运级别的科技成果”。

最近,全球各路大佬纷纷关注deepseek,黑神话悟空的创始人冯骥盛赞其为“国运级别的科技成果”。

作为一名普通用户,我为deepseek key充值了100元,因为免费提供的10元tokens资源实在不够用。

作为一名普通用户,我为deepseek key充值了100元,因为免费提供的10元tokens资源实在不够用。

这几天我用deepseek进行了大量测试,特别是在代码生成方面,其性能堪比gpt o1。例如,生成Python脚本时,可以直接使用,无需任何修改。

这几天我用deepseek进行了大量测试,特别是在代码生成方面,其性能堪比gpt o1。例如,生成Python脚本时,可以直接使用,无需任何修改。

deepseek的出现犹如平地惊雷,带来了“啊哈时刻”,让我们突然意识到在AI时代没有什么是不可能的。技术可能会被封锁,但创新的边界是无限的(请允许我用一些大词)。

对于个人来说也是如此,困境总是客观存在的,但如何积累力量、柳暗花明,则取决于主观努力。

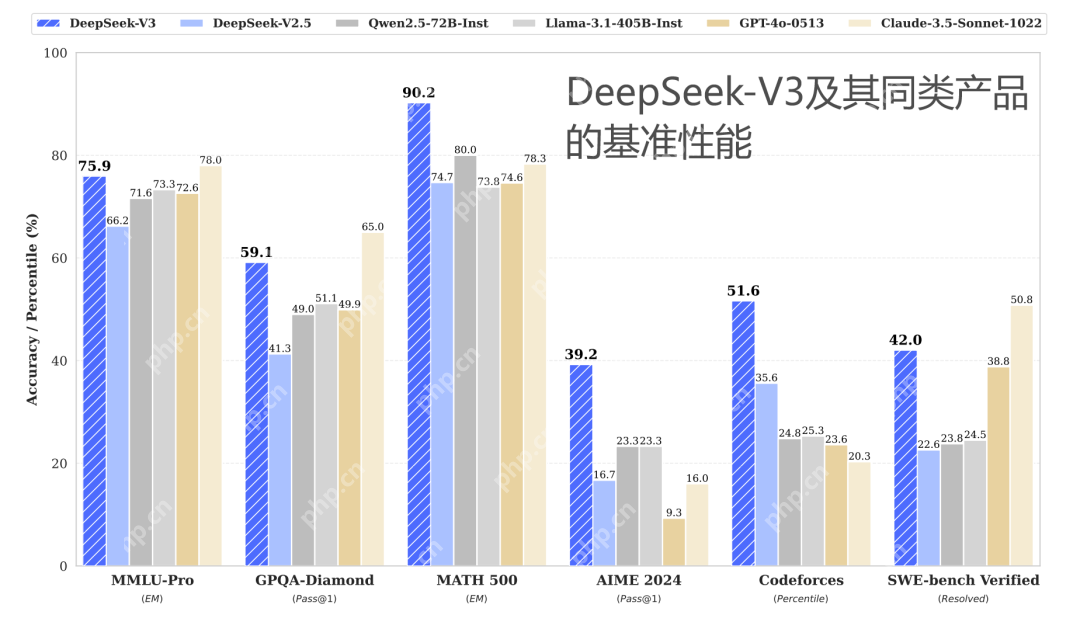

为什么DeepSeek的训练成本如此低,同时对话精确且速度极快?

我最近大致浏览了DeepSeek-V3的论文,有几点值得分享。

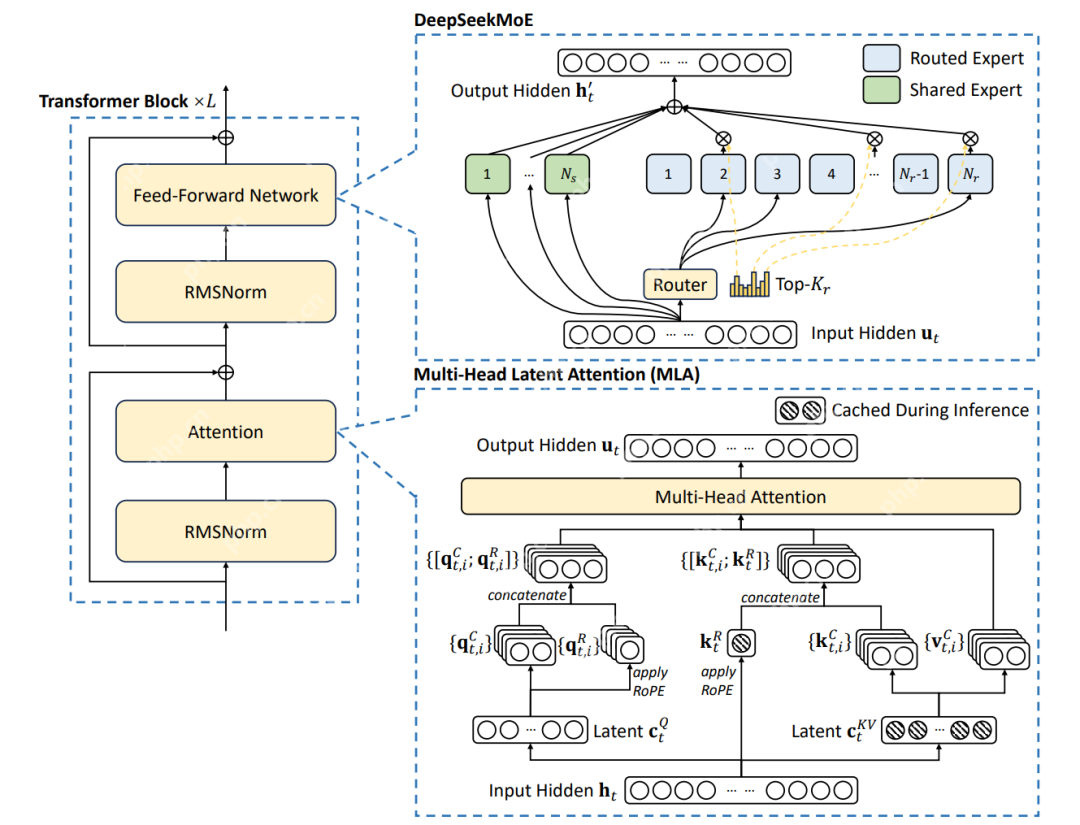

1、采用多头潜在注意力(MLA)来处理信息。

1、采用多头潜在注意力(MLA)来处理信息。

MLA不仅能保证性能,还能减少推理时需要存储的信息量。比如,将一本1000页的厚书提炼成10页精炼的笔记,这样既能快速查阅信息,又能减少不必要的存储空间,从而大大降低了训练成本,提升了对话速度。

2、采用DeepSeekMoE架构来分配任务。

2、采用DeepSeekMoE架构来分配任务。

DeepSeekMoE将不同功能的“专家”组织起来,让它们分工合作,处理不同类型的知识任务。例如,“编程专家”处理编程任务,“数学专家”处理数学问题,而不是让各种杂七杂八的专家一起来处理。这样使得对话更加精准,分工明确,效率极高。

3、采用多令牌预测(MTP)来预测tokens。

与传统模型一次预测一个单词不同,MTP能一次性预测多个后续单词,就像下棋时能预测对手后续好几步棋一样,这样预测会更加精准。不过,这个技术可能会导致一个问题,即模型会过度思考,使得回答思路更加发散。不知道大家有没有这样的感觉,deepseek会反复思考,甚至自己推翻自己。

4、训练方法的优化。

4、训练方法的优化。

例如,FP8混合精度训练框架和DualPipe算法,使得模型的资源消耗更低。

还有一点值得一提,deepseek的技术是开源的,现在各路AI公司都在复刻这个模型,很多人认为这样就失去了核心竞争力,但我认为这是一件好事。

有以下几个原因:

1、开源技术就像鲇鱼搅活了整个AI市场,会更加繁荣。

但是,deepseek的创新能力是无法复制的,产品迭代速度和质量也会领先一步。Apache软件也是开源的,但并没有人能取代它。

2、deepseek以病毒式的扩散速度在全球声量暴增,很大程度上归功于开源。

全球各路技术大神主动为其发声,手机端应用登顶各区Apple store下载榜首,这是花多少营销费用都换不来的。

3、开源技术也打了某些人的脸(认为deepseek是抄chatgpt的作业),现在我摊牌了,看你(gpt)怎么办。

最后,希望国产AI的发展越来越好。

菜鸟下载发布此文仅为传递信息,不代表菜鸟下载认同其观点或证实其描述。

相关文章

更多>>热门游戏

更多>>热点资讯

更多>>热门排行

更多>>- 武林战争游戏版本排行榜-武林战争游戏合集-2023武林战争游戏版本推荐

- 类似夺宝英雄的游戏排行榜_有哪些类似夺宝英雄的游戏

- 君王神途手游2023排行榜前十名下载_好玩的君王神途手游大全

- 元气神姬最新排行榜-元气神姬手游免费版下载-元气神姬免费破解版下载

- 多种热门耐玩的烈火沙城破解版游戏下载排行榜-烈火沙城破解版下载大全

- 2023天域诛仙手游排行榜-天域诛仙手游2023排行榜前十名下载

- 类似战双三国的游戏排行榜_有哪些类似战双三国的游戏

- 2023赏金传奇手游排行榜-赏金传奇手游2023排行榜前十名下载

- 元宝传奇手游排行-元宝传奇免费版/单机版/破解版-元宝传奇版本大全

- 类似神魔天尊的手游排行榜下载-有哪些好玩的类似神魔天尊的手机游戏排行榜

- 峥嵘仙梦手游排行-峥嵘仙梦免费版/单机版/破解版-峥嵘仙梦版本大全

- 风之幻想手游排行榜-风之幻想手游下载-风之幻想游戏版本大全